推荐的AIGC社区相关资源

2023 / 10 / 29

以下是我整理好的推荐资源

-

关于BLENDER和COMFYUI的结合

我是在B站一位名叫“只剩一瓶辣椒酱” 的UP主那里发现这个项目的。

他把Blender和ComfyUI结合的最初理由是想利用Blender中的汉化功能(当时ComfyUI在国内还不够知名,所以没有汉化脚本,或许这也是它早期普及速度慢的原因)。其次,Blender本身就有很多利用节点编辑器才能运作的功能,其特性与ComfyUI相类似。

在 Blender 中运行 ComfyUI 可以实现 Blender 和 ComfyUI 的无缝对接,相较于网页中的ComfyUI,在Blender中运行的ComfyUI具有以下几个优势:

-

更方便更有保障的工作流管理:节点工作流保存为Blender工程文件的格式,并且还有相关的自动保存和恢复功能避免你在工作时发生意外丢失数据。

-

利用 Blender 的强大的三维建模和动画功能,可以极大增强ComfyUI的控图能力。早在今年4月份,就有人开始探索利用StableDiffusion渲染Blender3D草图的可能性,但是当时Blender中的ComfyUI还在起步阶段,节点支持也有限,所以作者视频里的3D草图还是在WebUI中去渲染的,但现在可以直接在ComfyUI中一次性完成从建模到AI渲染的整个工作流

-

视频链接1 :探索利用StableDiffusion渲染Blender3D草图的可能性

-

视频链接2 :将SD的生图结果直接作为笔刷,为3D草图进行贴图渲染

-

视频链接3 :利用Blender生成的深度图作为Controlnet的输入来辅助控图

除了上述视频链接,我记得我先前还浏览过有人利用Blender的摄像机功能来高度控制绘图时的画面视角(正面,侧面等),还有人利用Blender来控制画面的光影,是在Controlnet中使用光束图控制光影的升级版。

由于我本人对Blender还是不够熟悉,所以更多的高级用法可能需要咨询3D建模业内的专业人士了。但我大胆猜测,目前已有,或者未来即将出现的一个用法就是将Blender的动画制作功能和AnimeDiff的AI动画结合起来,Blender精准地控制每一帧的图像,最后渲染生成的结果将会完全摆脱AnimeDiff现在存在的画面闪烁,人物面部不稳定的问题。

-

-

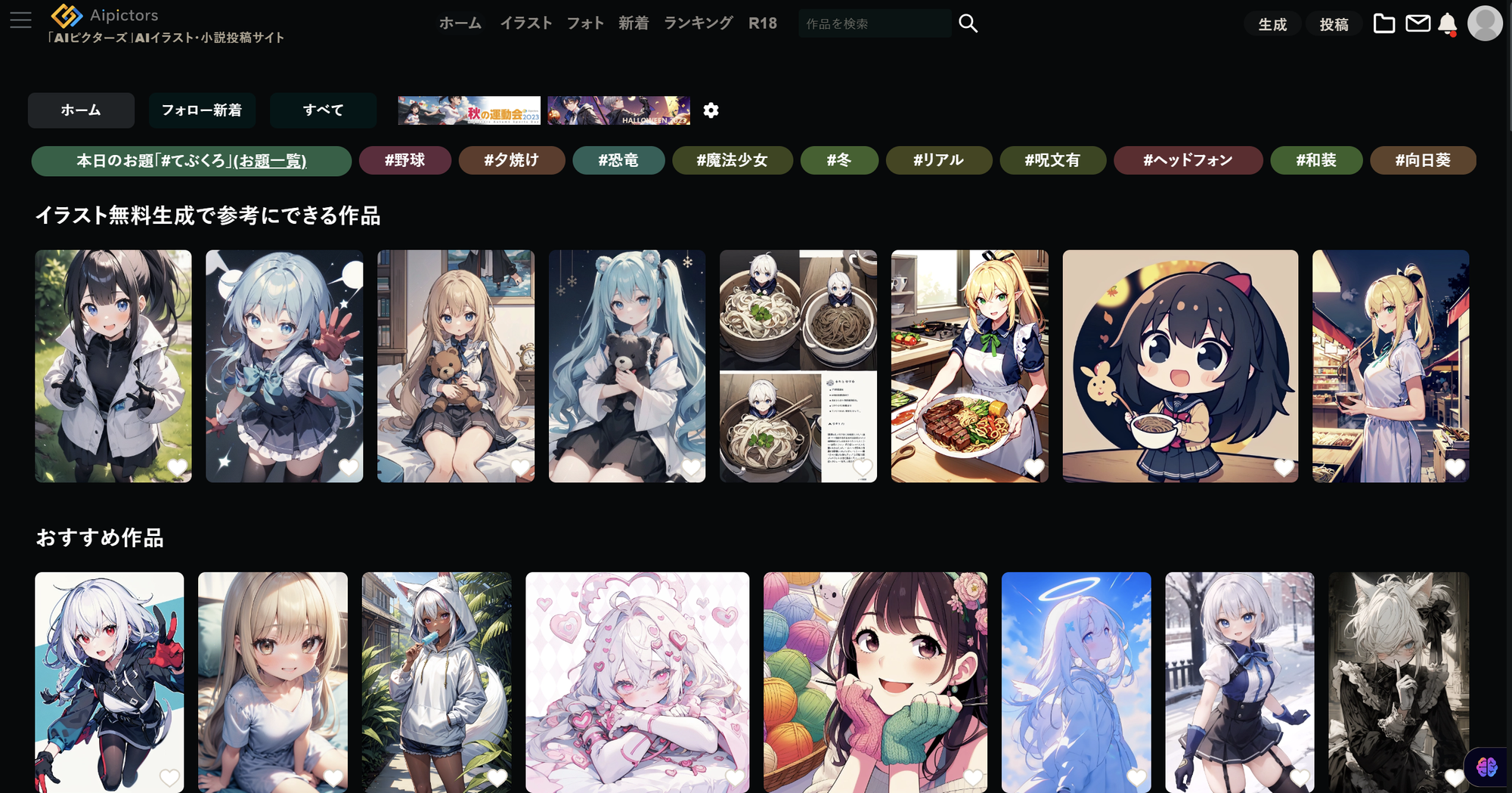

关于AI社区相关网站